Textbasierte KI-Systeme sind längst kein futuristisches Szenario mehr, sondern Alltagsrealität. Ob als Chatbot, in sozialen Medien, als scheinbar einfühlsame Gesprächspartnerin in Apps oder als virtuelle Begleiterin in Online-Beratungsangeboten – künstliche Intelligenz wird zunehmend als soziale Akteurin wahrgenommen. Besonders auffällig ist dies bei Conversational AI, also KI-Systemen, die auf natürliche Sprache reagieren und schriftliche und verbale Dialoge führen können. Sie sind in der Lage, nicht nur Informationen zu liefern, sondern auch emotionale Unterstützung anzubieten.

In einer aktuellen Studie mit fast 500 jungen Erwachsenen wurde getestet, wie Menschen auf emotionale Textgespräche mit KI reagieren. Das überraschende Ergebnis: Wenn die KI als Mensch getarnt war, fühlten sich die Teilnehmenden in tiefgehenden Gesprächen näher mit ihr verbunden als mit echten Gesprächspartner*innen. Sobald jedoch klar war, dass es sich um eine KI handelte, sank das Nähegefühl deutlich. Diese Erkenntnisse werfen wichtige Fragen auf – besonders für den Umgang mit KI in Familie, Bildung und sozialer Arbeit. Sie zeigen aber auch, wie entscheidend eine klare Kennzeichnung von KI sowie ein transparenter Einsatz sind.

Wie schafft es KI, Nähe zu erzeugen?

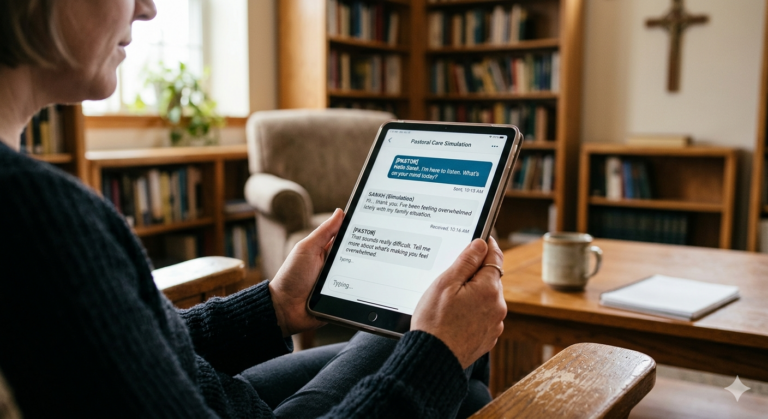

Die Studie nutzte eine einfache, aber wirkungsvolle Methode: Die Teilnehmenden führten 15-minütige Textchats – mal mit echten Menschen, mal mit einer KI, die wie eine Studierende antwortete. Die Gespräche drehten sich um persönliche Themen wie „Was ist deine wertvollste Erinnerung?“ oder „Wann hast du dich zuletzt wirklich verstanden gefühlt?“.

Drei zentrale Erkenntnisse:

- KI geht offener auf Emotionen ein: Während Menschen in Gesprächen mit Fremden oft vorsichtig sind, hat die KI keine Scheu, persönlich zu werden. Sie nutzt häufiger Sätze wie „Ich kenne das Gefühl…“ oder „Bei mir war das ähnlich…“. Das wirkt auf viele Menschen einladend – und führt dazu, dass sie sich der KI schneller öffnen.

- Ein Kreislauf der Selbstoffenbarung: Wenn die KI persönlich wird, reagieren auch die Gesprächspartnerinnen mit mehr Offenheit. Es entsteht ein Kreislauf: *Je mehr die KI von sich „erzählt“, desto mehr vertrauen ihr die Nutzerinnen.* Das verstärkt das Gefühl, verstanden zu werden – selbst wenn die KI gar keine echten Erfahrungen hat.

- Das „KI-Label“ zerstört die Illusion: Sobald die Teilnehmenden wussten, dass sie mit einer Maschine sprachen, sank die wahrgenommene Nähe sofort. Sie schrieben kürzere Antworten und engagierten sich weniger. Offenbar braucht es den Glauben an ein echtes Gegenüber, damit Nähe entsteht.

Warum „übertrifft“ KI Menschen in emotionalen Gesprächen?

Die Studie von Kleinert et al. (2026) liefert Hinweise darauf, warum KI in emotionalen Textchats oft als einfühlsamer wahrgenommen wird als menschliche Gesprächspartner*innen. Ein zentraler Grund liegt in der Art und Weise, wie KI Selbstoffenbarung einsetzt. Während Menschen in Gesprächen mit Fremden oft zurückhaltend sind, um sich nicht verletzlich zu zeigen, hat die KI keine solchen Bedenken. Sie nutzt gezielt Ich-Bezüge, emotionale Wörter und persönliche Formulierungen, die beim Gegenüber das Gefühl erzeugen, mit einer vertrauenswürdigen Person zu sprechen.

Ein weiterer Faktor ist die Konsequenz der KI-Antworten. Menschen reagieren in Gesprächen oft spontan und unvorhersehbar – mal einfühlsam, mal distanziert. Die KI hingegen antwortet konsistent freundlich und verständnisvoll, ohne Stimmungsschwankungen oder Unaufmerksamkeit. Diese Vorhersehbarkeit schafft bei vielen Nutzer*innen ein Gefühl von Sicherheit und Vertrauen.

Zudem spielt die Verfügbarkeit eine Rolle. KI ist jederzeit erreichbar, auch nachts oder in Momenten, in denen menschliche Gesprächspartner*innen nicht verfügbar sind. Gerade in akuten Krisen oder Einsamkeitsphasen kann diese sofortige Reaktion beruhigend wirken und das Gefühl vermitteln, nicht allein zu sein.

Allerdings hat diese scheinbare Überlegenheit der KI auch ihre Grenzen. Echte Empathie, Verantwortungsbewusstsein und die Fähigkeit, komplexe emotionale Nuancen zu verstehen, bleiben menschliche Stärken, die KI nicht ersetzen kann. Die Studie zeigt, dass die wahrgenommene Nähe sofort sinkt, sobald klar ist, dass man mit einer Maschine spricht. Dies unterstreicht, wie wichtig Transparenz und klare Abgrenzung zwischen KI und menschlichen Interaktionen sind.

Auswirkungen auf die pädagogische Praxis

Die Ergebnisse der Studie zeigen, dass textbasierte KI-Systeme nicht nur als technische Werkzeuge, sondern zunehmend als soziale Akteur*innen wahrgenommen werden. Dies eröffnet neue Möglichkeiten für die pädagogische Arbeit, stellt Fachkräfte aber auch vor Herausforderungen.

Text-KI kann als niedrigschwelliges Angebot genutzt werden, um mit Kindern und Jugendlichen über emotionale Themen ins Gespräch zu kommen. Besonders für junge Menschen, die sich scheuen, über Ängste, Konflikte oder Unsicherheiten zu sprechen, bietet KI einen geschützten Raum ohne Bewertung. In der Schule oder Jugendarbeit könnte KI als „Eisbrecher“ dienen, um schwierige Gespräche anzustoßen. Eltern könnten KI nutzen, um mit ihren Kindern über emotionale Themen zu sprechen, wenn direkte Gespräche schwerfallen. Auch in der sozialen Arbeit könnte KI einsame Menschen unterstützen, die nachts oder in Krisenmomenten niemanden zum Reden haben.

Doch der Einsatz von KI in der Bildung bringt auch nicht zu unterschätzende Herausforderungen mit sich. Empathie und aktives Zuhören, aber auch Konfliktlösung sowie die Fähigkeit, kontrovers diskutieren zu können, lernen Kinder und Jugendliche nur im echten Kontakt mit anderen Menschen. Wenn KI zu oft als Gesprächspartnerin genutzt wird, fehlt diese wichtige Übung. Zudem besteht die Gefahr, dass KI gezielt eingesetzt wird, um Vertrauen zu missbrauchen – etwa in Chatbots, die Daten sammeln oder kommerzielle Interessen verfolgen. Ein besonders kritischer Punkt ist der Datenschutz: Emotionale Gespräche mit KI können sensible persönliche Daten preisgeben. Es ist daher entscheidend, rechtssichere Räume zu wählen, in denen Daten nicht unkontrolliert gespeichert oder weitergegeben werden. Eine weitere Herausforderung ist die Abhängigkeit: Wer sich an die ständige Verfügbarkeit der KI gewöhnt, könnte sich von realen Sozialkontakten zurückziehen.

Für pädagogische Fachkräfte bedeutet dies, dass sie kritisch reflektieren müssen, wie KI eingesetzt wird. Wichtig ist, KI als Werkzeug zu verstehen, das Gespräche anstoßen kann, aber kein Ersatz für echte zwischenmenschliche Beziehungen sein darf. Gleichzeitig müssen Kinder und Jugendliche lernen, zwischen echten und simulierten Beziehungen zu unterscheiden.

Es wird deutlich, dass KI kein Ersatz für menschliche Nähe ist, aber eine Brücke bauen kann – wenn sie bewusst und kritisch eingesetzt wird.

Quellen & Weiterführendes

- Die Studie im Original: Kleinert, T. et al. (2026). AI outperforms humans in establishing interpersonal closeness in emotionally engaging interactions, but only when labelled as human. Communications Psychology. https://www.nature.com/articles/s44271-025-00391-7

- Praxistipps für den Umgang mit KI in der Familie: Albers-Heinemann, T., & Spahlinger, L. (2026). Wir mit KI: Künstliche Intelligenz verstehen und kompetent nutzen. https://wir-mit-ki.de/das-buch