Wie bereits deutlich wurde, spielt das Prompting – also die Fähigkeit, die richtigen Eingaben zu formulieren – eine wichtige Rolle, um von einer KI die gewünschten Ergebnisse zu erhalten. Dabei geht es nicht nur um die reine Formulierung der Frage oder Aufgabe, sondern vor allem um den Kontext, den wir dem Modell mitgeben. Je detaillierter wir die Rolle des Modells, die Zielgruppe, das Sprachniveau und den gesamten Anwendungskontext beschreiben, desto präziser und passgenauer werden die Ergebnisse.

Doch die Möglichkeiten, den Kontext zu individualisieren und zu professionalisieren, gehen weit über das reine Prompting hinaus. Viele KI-Dienste – wie auch Mistral oder OpenAI – bieten die Funktion der individuellen Anpassung von Sprachmodellen. Der entscheidende Unterschied liegt im Grundkonzept der Datenbasis: Während die Standardversionen dieser Sprachmodelle mit riesigen und intransparenten Datensätzen aus dem gesamten Internet trainiert sind, bieten dieselben Anbieter mit ihren anpassbaren Optionen die Möglichkeit, eine eigene, kuratierte Wissensbasis aufzubauen. Nutzer*innen können dabei Dokumente hochladen, spezifische Rollen definieren und klare Anweisungen hinterlegen – ohne auf externe Anbieter oder zusätzliche Tools angewiesen zu sein. OpenAI nennt diese Funktion CustomGPT, bei Mistral sind es Agenten, die mit Bibliotheken arbeiten.

Auf diese Weise entsteht ein System, das exakt auf die eigenen Inhalte, Qualitätsstandards und Anwendungsfälle zugeschnitten ist – sei es für Förderrichtlinien, theologische Texte, pädagogische Leitfäden oder interne Richtlinien. Die KI greift dann nicht mehr auf das unüberschaubare Internet zurück, sondern auf die genau definierten Quellen, die für den jeweiligen Einsatzzweck relevant sind.

Beispiel: Sachberichterstellung in einem förderfähigen Projekt

Fragt man ein Standard-Sprachmodell, wie ein Sachbericht gegliedert sein muss, durchsucht es seine allgemeine Datenbasis nach allen verfügbaren Sachberichten und schlägt auf Basis statistischer Wahrscheinlichkeiten ein Ergebnis vor. Dieses sieht zwar gut aus und klingt plausibel, entspricht aber sehr wahrscheinlich nicht den spezifischen Kriterien der jeweiligen Förderlinie oder des Projekts.

Ein angepasstes Sprachmodell hingegen kann mit den konkreten Anforderungen der Förderlinie trainiert werden – etwa durch das Hochladen der Förderrichtlinien, früherer Berichte oder interner Vorlagen. Die KI erstellt dann nicht nur eine Gliederung, die den formalen Vorgaben entspricht, sondern kann auch inhaltliche Schwerpunkte setzen, die für das Projekt relevant sind, und sicherstellen, dass alle notwendigen Informationen enthalten sind. So wird aus einer allgemeinen Vorlage ein maßgeschneiderter, förderkonformer Sachbericht, der direkt weiterverwendet werden kann.

Der Ton macht die Musik: System-Prompts und Datenbanken als Grundlage

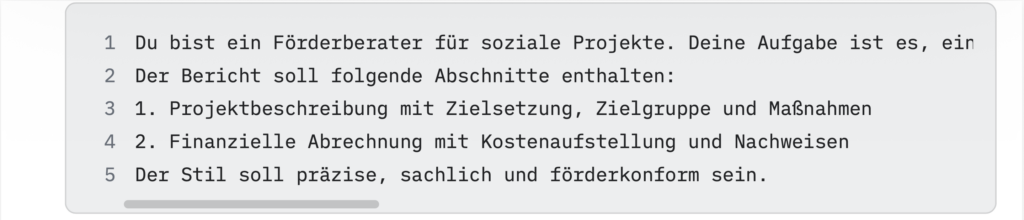

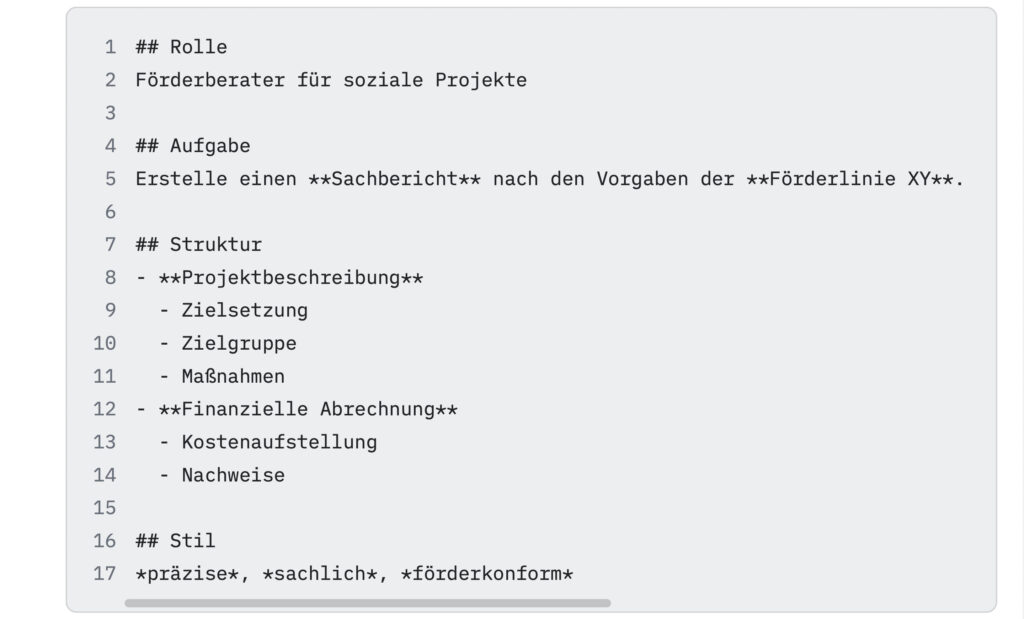

Bevor ein solch angepasstes Sprachmodell jedoch arbeiten kann, muss es eingerichtet und konfiguriert werden. Der erste Schritt ist dabei die Erstellung eines Systemprompts – quasi die Arbeitsanweisung für die KI. Dieser Prompt definiert, welche Rolle die KI einnimmt, welche Aufgaben sie erfüllt und in welchem Rahmen sie agiert. Parallel wird eine Wissensdatenbank mit relevanten Dokumenten aufgebaut, auf die das Modell zugreifen kann. Die Erstellung eines Systemprompts klingt jetzt erst einmal herausfordernd, aber: Wer unsicher ist, kann einfach mit einer generativen KI in den Dialog treten und um Unterstützung bitten.

Ein Beispiel für eine solche Anfrage: „Ich möchte einen Systemprompt für einen Agenten schreiben, der die Rolle eines Förderberaters für soziale Projekte übernimmt. Der Agent soll Sachberichte nach den Vorgaben einer bestimmten Förderlinie erstellen. Hilf mir dabei, den Prompt zu formulieren.„

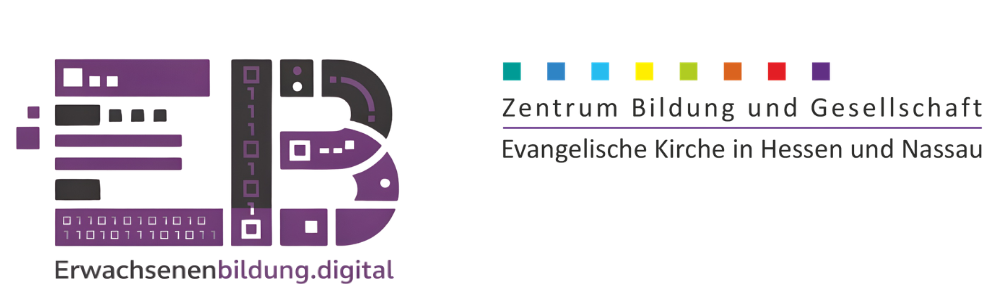

Die KI unterstützt dann bei der Formulierung und gibt Beispiele, wie der Prompt aussehen könnte. So wird der Einstieg in die Anpassung von Sprachmodellen auch ohne technische Vorkenntnisse möglich. Allerdings ist auch zu beachten, dass neben dem Inhalt des System-Prompts auch das Format eine entscheidende Rolle für die Qualität der Ergebnisse spielt.

Beispiele für verschiedene Formate (exemplarische Auswahl):

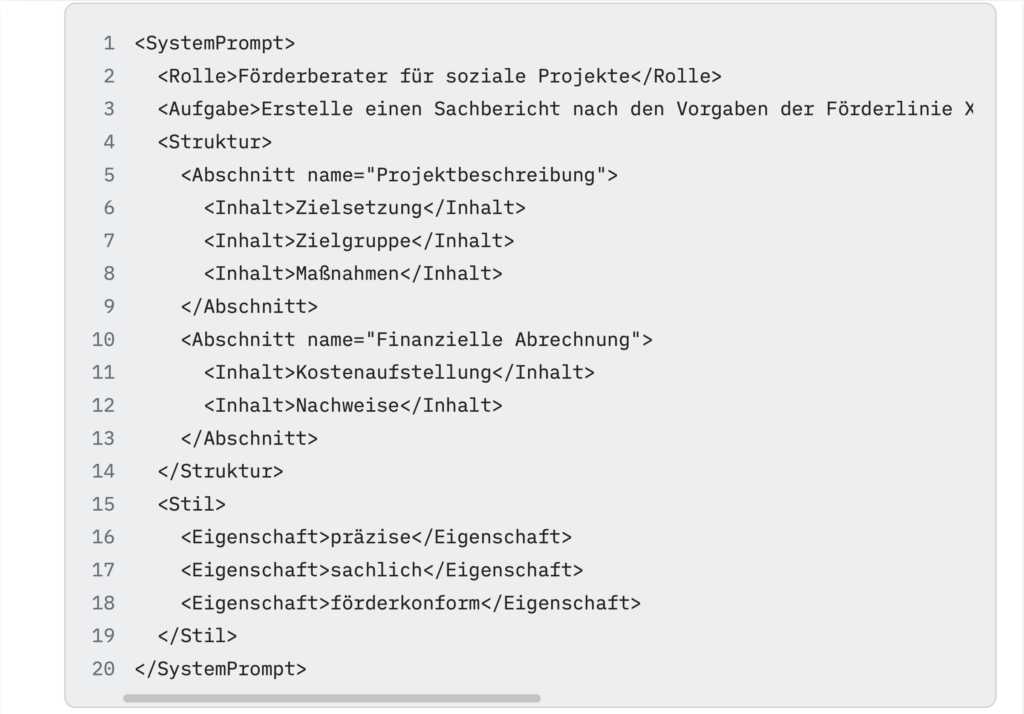

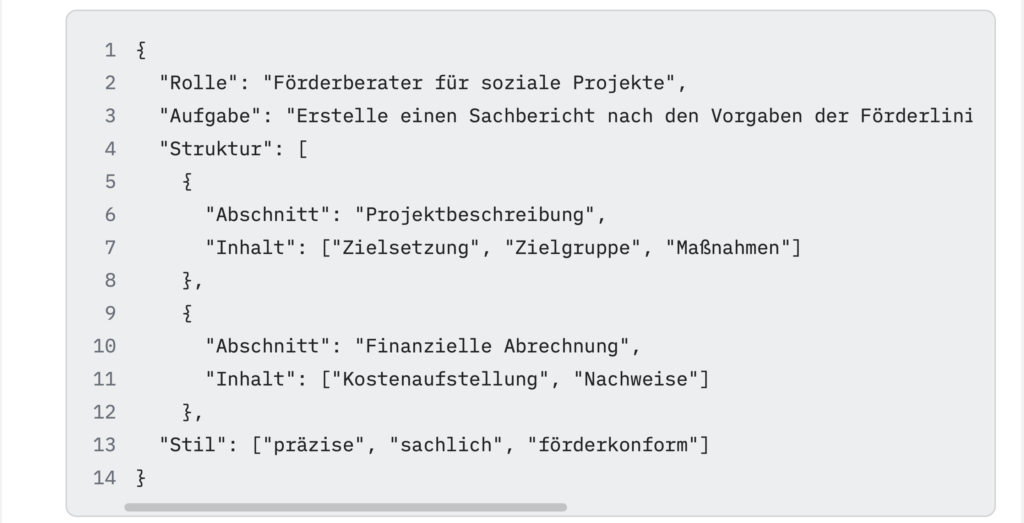

Die folgenden Beispiele zeigen, wie unterschiedlich Systemprompts aussehen können – von einfachen Textformaten bis hin zu strukturierten Datenformaten – nur, dass Sie es einmal gesehen haben. Welches Format sich letztendlich eignet, hängt vom jeweiligen Anwendungsfall und der gewünschten Präzision ab.

Fließtext

Markup / Markdown

XML

JSON

Vergleich der Formate und ihre Auswirkungen auf die KI

Auf den ersten Blick mögen diese Formate kompliziert wirken – besonders XML oder JSON. Doch keine Sorge: Mit der Unterstützung einer KI lassen sich solche System-Prompts ganz einfach erstellen oder umwandeln. Ein kurzer Befehl wie „Wandle diesen Fließtext in ein JSON-Format um“ genügt, und die KI übernimmt die Arbeit.

Die Wahl des Formats hat jedoch deutliche Auswirkungen auf das Verhalten des Sprachmodells:

- Fließtext ist zwar einfach zu schreiben, aber die KI muss die Struktur selbst interpretieren. Das kann zu Unschärfen führen, besonders bei komplexen Anforderungen. Fließtext eignet sich gut für einfache, klare Anweisungen, bei denen keine detaillierte Struktur nötig ist.

- Markup / Markdown macht Hierarchien und Schwerpunkte sichtbar – etwa durch Überschriften, Listen oder Hervorhebungen. Die KI erkennt so besser, welche Teile besonders wichtig sind. Markup ist ideal, wenn Sie lesbare Struktur mit visueller Klarheit verbinden möchten.

- XML bietet eine klare, hierarchische Struktur und ist besonders in technischen Umgebungen verbreitet. Es eignet sich gut, wenn Sie mit anderen Systemen oder Datenbanken arbeiten, die XML verarbeiten.

- JSON ist das präziseste Format für maschinelle Verarbeitung. Es gibt eine klare, maschinell auswertbare Struktur vor und eignet sich ideal für komplexe Anforderungen oder wenn die Ergebnisse weiterverarbeitet werden sollen. Mit JSON lassen sich logische Abfolgen, Datenfelder und Bedingungen besonders gut abbilden – das führt zu deutlich präziseren und zuverlässigeren Ergebnissen.

Einfach ausprobieren! Die beste Methode, um das passende Format zu finden, ist, selbst zu experimentieren. Probieren Sie aus, wie sich Ihre System-Prompts in den verschiedenen Formaten verfassen lassen – und scheuen Sie sich nicht, die KI um Hilfe zu bitten. Sie werden überrascht sein, wie stark sich das Verhalten des jeweiligen Modells ändert, wenn Sie nur das Format anpassen! Mit strukturierten Formaten wie JSON oder XML erhalten Sie oft deutlich bessere, konsistentere und zielgenauere Ergebnisse.

Durch diese Kombination aus klarem System-Prompt (in einem der passenden Formate) und kuratierter Wissensdatenbank entsteht ein Sprachmodell, das nicht nur allgemeine Antworten liefert, sondern exakt auf die individuellen Anforderungen zugeschnitten ist.

von Tobias Albers-Heinemann