Ein typisches Szenario: Eine Fachkraft in der Erwachsenenbildung arbeitet an einem Sachbericht für ein Förderprojekt. Sie nutzt generative KI, um eine Gliederung zu erstellen – in der Erwartung, dass die KI automatisch die aktuellen Vorgaben der fördergebenden Einrichtung kennt und umsetzt. Das Ergebnis: ein plausibel klingender Vorschlag, der jedoch nicht den tatsächlichen Anforderungen entspricht. Die Folge: Frustration. Die KI hat nicht „versagt“, sie hat einfach nicht das geleistet, was Nutzer*innen fälschlicherweise von ihr erwarten.

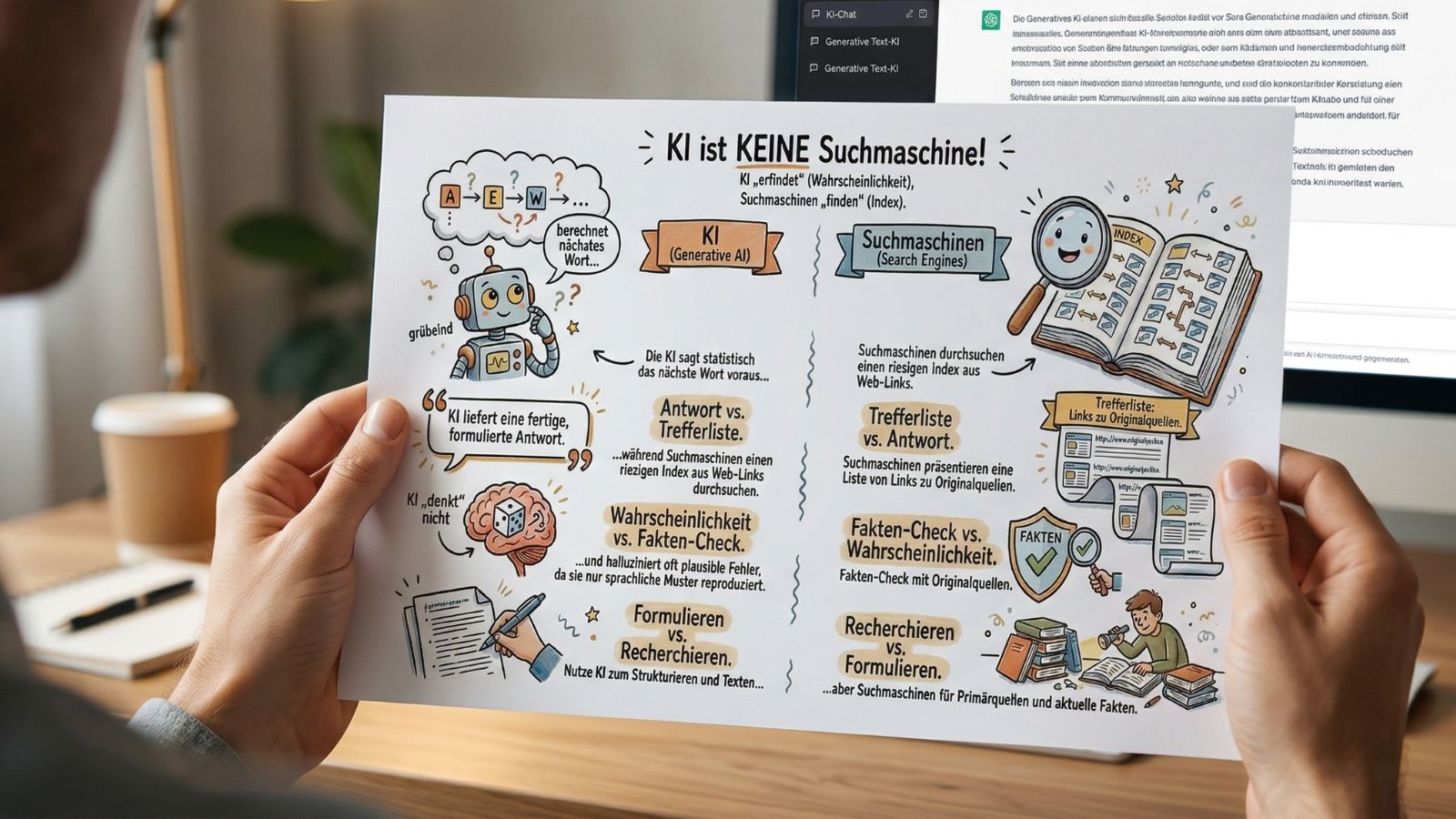

Dieses Beispiel zeigt ein weit verbreitetes Missverständnis: Generative KI wird wie eine Suchmaschine oder Datenbank behandelt – mit dem Unterschied, dass sie keine Fakten abruft, sondern Muster reproduziert. Doch während Suchmaschinen existierende Informationen finden, erfindet KI lediglich, was sprachlich wahrscheinlich klingt. Wer das nicht versteht, riskiert, die Technologie falsch einzuschätzen – und scheitert an den eigenen Erwartungen.

Suchmaschinen: Finden, was existiert

Suchmaschinen wie Google oder Bing arbeiten nach einem klaren und nachvollziehbaren Prinzip: Sie durchsuchen einen riesigen Index aus Web-Links, der kontinuierlich aktualisiert wird. Ihr primäres Ziel besteht darin, bereits existierende Informationen aufzufinden und Nutzer*innen zugänglich zu machen. Dabei folgt ihre Funktionsweise einer einfachen, aber effektiven Logik: Statt fertige Antworten zu liefern, präsentieren sie eine Trefferliste – eine geordnete Auswahl an Quellen, die zu einer Suchanfrage passen könnten. Die eigentliche Arbeit beginnt jedoch erst hier: Nutzer*innen müssen selbst bewerten, welche der verlinkten Inhalte relevant, vertrauenswürdig und korrekt sind. Suchmaschinen übernehmen also nicht die Rolle einer Instanz, die Fakten prüft oder Wahrheiten feststellt. Stattdessen verweisen sie auf Originalquellen, sei es ein wissenschaftlicher Artikel, eine offizielle Webseite oder ein Nachrichtenbeitrag. Die Verantwortung für die Richtigkeit und Qualität der Informationen liegt damit bei den Autor*innen dieser Quellen.

Ein weiterer zentraler Aspekt ist, dass Suchmaschinen in erster Linie als Recherchewerkzeuge dienen. Sie helfen dabei, Primärquellen, aktuelle Daten oder Hintergrundinformationen zu finden, wie beispielsweise die korrekten Vorgaben für einen Sachbericht einer bestimmten Förderlinie. Wer eine Suchmaschine nutzt, erwartet keine kreative Leistung oder eine interpretierende Aufbereitung der Ergebnisse. Vielmehr geht es um eine gefilterte Auswahl an bereits veröffentlichten Inhalten, die als Grundlage für eigene Analysen, Entscheidungen oder weiterführende Recherchen dienen. Suchmaschinen sind somit ein unverzichtbares Instrument, um sich in der Flut digitaler Informationen zu orientieren – vorausgesetzt, man geht kritisch und reflektiert mit den gefundenen Treffern um. Sie ersetzen weder das eigene Denken noch die Notwendigkeit, Quellen zu hinterfragen.

Generative KI: Erfinden auf Basis von Mustern

Generative KI, wie sie in Sprachmodellen wie ChatGPT, Gemini oder LeChat zum Einsatz kommt, funktioniert grundlegend anders als eine Suchmaschine. Während Suchmaschinen bestehende Informationen aus einem Index abrufen, generiert KI Texte auf Basis statistischer Wahrscheinlichkeiten. Sie analysiert riesige Mengen an Textdaten, erkennt darin wiederkehrende Muster – etwa typische Satzstrukturen, Formulierungen oder inhaltliche Zusammenhänge – und berechnet, welches Wort oder welcher Satz als Nächstes am wahrscheinlichsten passt. Dabei erfindet die KI keine Fakten im eigentlichen Sinne. Stattdessen produziert sie Texte, die sprachlich plausibel wirken, weil sie den Mustern ähneln, die sie während ihres Trainings „gelernt“ hat. Das Ergebnis ist daher keine Abbildung der Realität, sondern eine dynamische Simulation von Sprache.

Der kleine aber feine Unterschied

Diese Arbeitsweise hat weitreichende Konsequenzen für den praktischen Einsatz: Generative KI ist kein Werkzeug, um Fakten für z.B. einen Förderantrag zu recherchieren oder gesichertes Wissen abzurufen. Vielmehr eignet sie sich besonders, um Texte zu strukturieren, kreative Ideen zu entwickeln oder komplexe Inhalte verständlich aufzubereiten. Sie kann beispielsweise helfen, eine Gliederung für einen Bericht zu entwerfen, Formulierungen zu optimieren oder verschiedene Perspektiven auf ein Thema zu skizzieren. Doch wer sie wie eine Suchmaschine behandelt und erwartet, dass sie korrekte Informationen oder aktuelle Daten liefert, wird schnell an Grenzen stoßen. Der häufige Vorwurf, KI „halluziniere“, entsteht oft genau dann, wenn Nutzer*innen diese Unterschiede nicht beachten. Die KI reproduziert lediglich sprachliche Muster – und wenn diese Muster in den Trainingsdaten unvollständig, veraltet oder sogar falsch waren, übernimmt sie diese Fehler.

Der entscheidende Unterschied lässt sich auf einen einfachen Nenner bringen: Suchmaschinen finden, was tatsächlich existiert. Generative KI formuliert, was wahrscheinlich klingt. Wer das versteht, kann die Technologie gezielt einsetzen – etwa als Sparringspartner für kreative Prozesse oder als Hilfsmittel, um eigene Gedanken zu strukturieren. Wer das nicht berücksichtigt, riskiert, unkritisch plausibel klingende, aber inhaltlich fragwürdige Ergebnisse zu übernehmen. Die Verantwortung, die generierten Inhalte zu prüfen und mit gesichertem Wissen abzugleichen, liegt stets bei den Nutzer*innen. KI ist ein mächtiges Werkzeug, aber kein Ersatz für kritisches Denken oder fundierte Recherche.

KI-Suchmaschinen: Eine neue Kategorie?

In letzter Zeit sind auch sogenannte KI-Suchmaschinen wie Perplexity oder die neue Google KI-Suche entstanden, die versuchen, die Lücke zwischen klassischer Suche und generativer KI zu schließen. Diese Tools kombinieren oft beides: Sie durchsuchen einen Index, nutzen aber gleichzeitig KI, um die Ergebnisse zusammenzufassen oder zu interpretieren. Das klingt zwar effizient, ist aber kein Garant für korrekte Informationen. Erste Erfahrungen mit KI-Suchmaschinen wie der Google-KI-Suche zeigen, dass die generierten Zusammenfassungen nicht immer deckungsgleich mit den tatsächlichen Inhalten der Quellen sind. Die KI kann dabei wichtige Nuancen übersehen, falsche Schlüsse ziehen oder sogar Informationen „glätten“, die im Original anders dargestellt werden. Nutzer*innen sollten daher immer die Originalquellen prüfen und sich nicht allein auf die KI-Zusammenfassung verlassen. KI-Suchmaschinen sind also kein Allheilmittel, sondern eine Ergänzung, die kritisch und reflektiert genutzt werden will.