Die Debatte um den Einsatz von Künstlicher Intelligenz (KI) wird oft in Schwarz-Weiß-Kategorien geführt: Erlaubt oder verboten, nützlich oder gefährlich. Doch die Realität ist komplexer. KI ist längst kein optionales Add-on mehr, sondern durchdringt unsere Arbeitsumgebungen. Ob in Textverarbeitungsprogrammen, die uns nicht nur Rechtschreibfehler korrigieren, sondern ganze Sätze umformulieren, oder in Suchmaschinen, die unsere Anfragen nicht nur beantworten, sondern antizipieren: KI ist tief in die Software integriert, die wir täglich nutzen. Sie arbeitet im Hintergrund von Betriebssystemen, optimiert Cloud-Dienste und unterstützt uns bei der Recherche, indem Algorithmen Ergebnisse priorisieren oder um zusätzliche Kontextinformationen ergänzen. Selbst wer sich bewusst gegen den Einsatz von KI entscheidet, kommt kaum umhin, ihre unsichtbaren Assistenzfunktionen zu nutzen – sei es durch automatische Updates, intelligente Tabellenkalkulationen oder die Integration von KI-gestützten Suchfunktionen in Standardanwendungen.

Diese Allgegenwart wirft eine zentrale Frage auf: Ist ein vollständiger Verzicht auf KI überhaupt noch möglich? Die Antwort lautet: praktisch nein. Doch genau deshalb wird es umso dringlicher, ein Bewusstsein für die verschiedenen Stufen der Kollaboration zwischen Mensch und Maschine zu entwickeln. Es geht nicht mehr darum, KI pauschal zu erlauben oder zu verbieten, sondern darum, verantwortungsvoll zu entscheiden, welche Formen des Einsatzes sinnvoll, ethisch vertretbar und transparent kommunizierbar sind. Nur so können wir sicherstellen, dass wir die Technologie als Werkzeug nutzen – und nicht umgekehrt.

Zwischen menschlicher Kreation und voller Autonomie

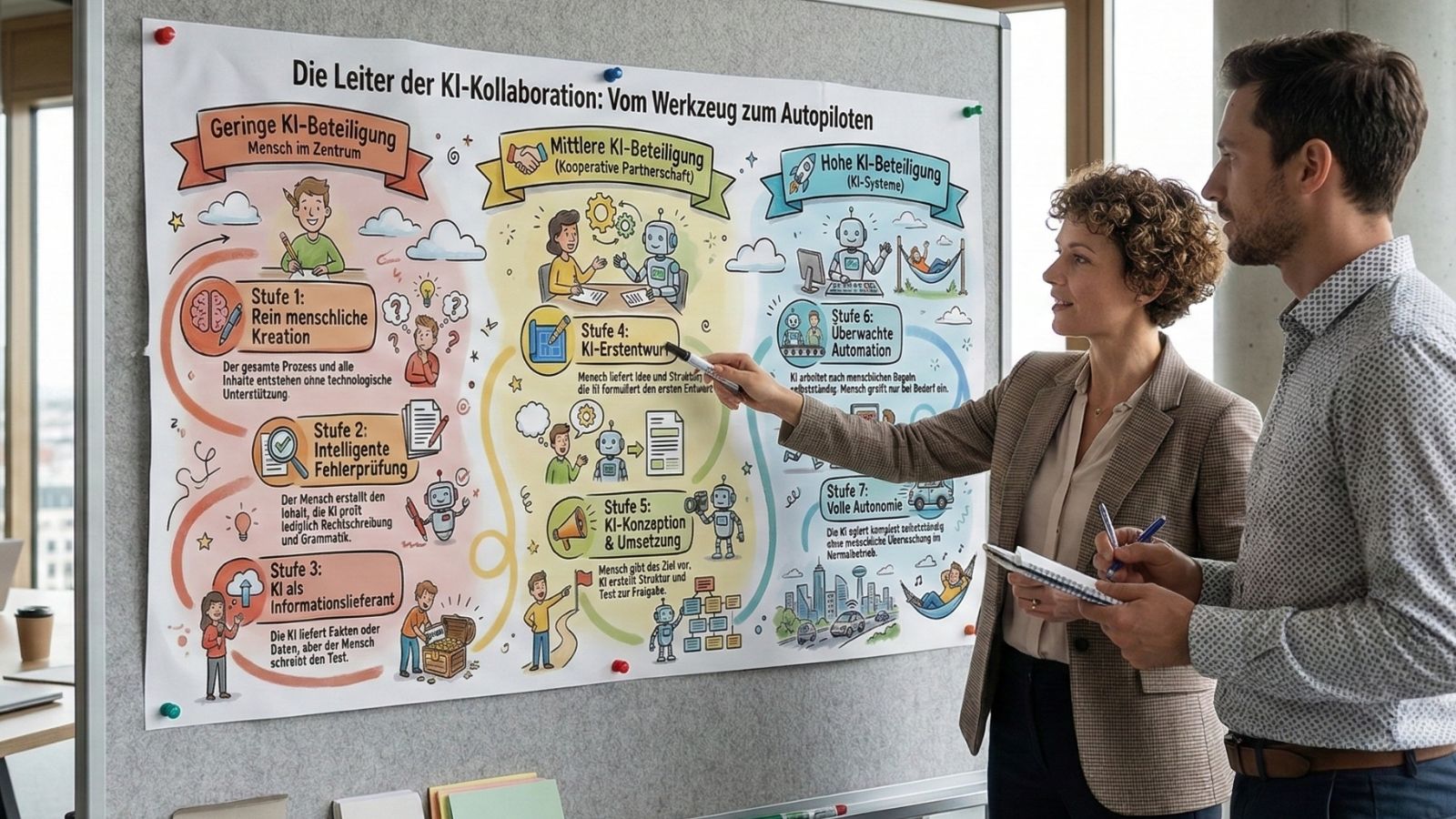

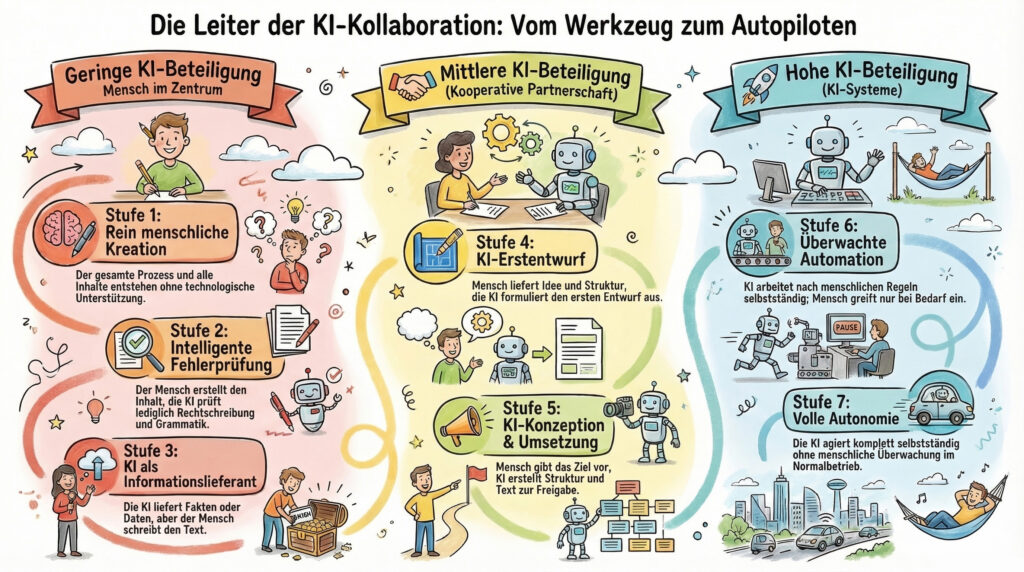

Die Kollaboration zwischen Mensch und KI lässt sich unserer Meinung nach in sieben Stufen unterteilen, die zeigen, wie vielfältig und unterschiedlich intensiv diese Zusammenarbeit sein kann. Dieses Modell ist ein praxisbasiertes Konzept, entwickelt aus eigener pädagogischer Erfahrung statt aus wissenschaftlicher Forschung. Jede Stufe beschreibt ein anderes Maß an menschlicher Kontrolle und maschineller Unterstützung – von der rein menschlichen Arbeit bis hin zur vollständigen Autonomie der KI.

Auf der ersten Stufe, der rein menschlichen Kreation, entstehen Prozesse und Inhalte komplett ohne technologische Unterstützung. Ein Beispiel hierfür wäre ein handgeschriebener Text oder eine Skizze auf Papier. Doch selbst hier stellt sich die Frage, ob wir in einer digitalisierten Welt überhaupt noch gänzlich ohne KI-Unterstützung arbeiten können.

Die zweite Stufe, die intelligente Fehlerprüfung, beschreibt den Einsatz von KI als Korrekturwerkzeug. Der Mensch erstellt den Inhalt, während die KI lediglich Rechtschreibung, Grammatik oder Plausibilität prüft – etwa durch Tools wie Duden Mentor oder die Rechtschreibprüfung in Word. Hier beginnt bereits die Diskussion: Wo hört reine Hilfe auf, und wo beginnt die inhaltliche Beeinflussung?

Auf der dritten Stufe fungiert die KI als Informationslieferant. Sie stellt Fakten oder Daten bereit, während der Mensch den Text verfasst. Ein typisches Beispiel ist die Recherche mit KI-gestützten Suchmaschinen oder die Zusammenfassung von Studien durch KI. Doch wie zuverlässig sind diese Quellen, und wer übernimmt die Verantwortung für mögliche Fehler?

Die vierte Stufe, der KI-Erstentwurf, geht einen Schritt weiter: Der Mensch gibt Idee und Struktur vor, während die KI einen ersten Entwurf formuliert. Das spart Zeit, birgt aber das Risiko, dass die eigene Stimme verloren geht und ein typischer „KI-Sprech“ entsteht. KI-generierte Rohtexte, die anschließend überarbeitet werden, sind ein gutes Beispiel dafür.

Bei der fünften Stufe, der KI-Konzeption und Umsetzung, arbeiten Mensch und KI partnerschaftlich zusammen. Der Mensch setzt die Ziele, während die KI Struktur und Text erstellt – etwa bei der Erstellung von Konzeptentwürfen für Projekte oder Unterrichtsmaterialien. Doch wer ist hier eigentlich Urheber*in, und wie viel Kreativität bleibt beim Menschen?

Die sechste Stufe, die überwachte Automation, beschreibt eine Situation, in der die KI nach vorgegebenen Regeln selbstständig arbeitet, während der Mensch nur noch bei Bedarf eingreift. Automatisierte Berichte oder Chatbots in der Kundenkommunikation sind typische Anwendungsfälle. Doch ab wann wird der Mensch zum bloßen Kontrolleur statt zum aktiven Gestalter?

Die siebte und letzte Stufe schließlich ist die volle Autonomie. Hier agiert die KI komplett selbstständig, ohne menschliche Überwachung im Normalbetrieb. Autonome Social-Media-Posts oder KI-gesteuerte Entscheidungsprozesse sind Beispiele dafür. Doch diese Stufe wirft drängende ethische Fragen auf: Darf KI ohne menschliche Instanz handeln, und wo bleiben Verantwortung und Reflexion?

Diese sieben Stufen zeigen, wie komplex und vielschichtig die Zusammenarbeit mit KI sein kann. Sie machen deutlich, dass es nicht um ein einfaches „Ja“ oder „Nein“ zur KI-Nutzung geht, sondern um eine differenzierte Auseinandersetzung mit den Möglichkeiten und Grenzen dieser Technologie.

Warum Transparenz entscheidend ist

Das 7-Stufen-Modell der KI-Kollaboration ist nicht nur ein Analysewerkzeug, um die eigene Nutzung von KI zu reflektieren, sondern vor allem ein Instrument der Transparenz. Für Nutzer*innen schafft eine klare Kommunikation darüber, wie KI eingesetzt wird, Vertrauen und Sicherheit im Umgang mit der Technologie. Institutionen profitieren davon, dass sie differenzierte Richtlinien entwickeln können – etwa indem sie festlegen, dass nur bestimmte Stufen, wie „bis Stufe 3 erlaubt“, in ihrem Kontext Anwendung finden. Für die Gesellschaft insgesamt ermöglicht das Modell eine informierte Debatte über die Grenzen und Möglichkeiten von KI, die über pauschale Bewertungen hinausgeht.

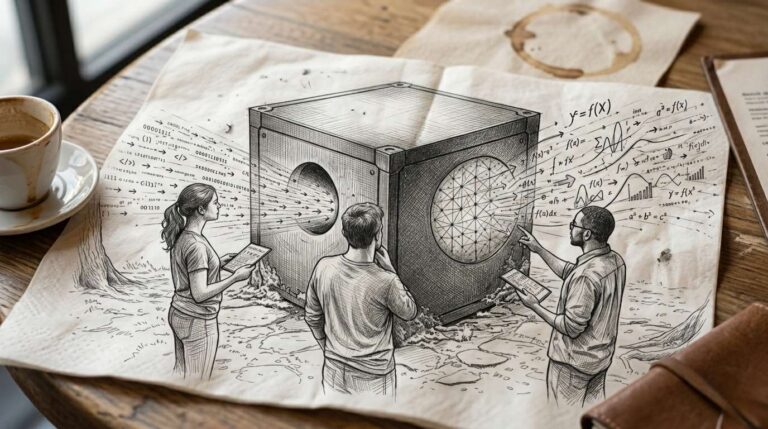

In der praktischen Anwendung hilft das Modell bei der Selbsteinschätzung: Auf welcher Stufe bewegt sich meine Arbeit, und wo möchte ich bewusst Grenzen setzen? Es unterstützt Teamabsprachen, indem es eine gemeinsame Grundlage bietet, um zu diskutieren, welche Stufen der KI-Nutzung im eigenen Kontext akzeptabel sind. Nicht zuletzt ist es ein wertvolles Werkzeug für die Bildungsarbeit, um Kompetenzen für einen reflektierten und verantwortungsvollen Umgang mit KI zu vermitteln. Transparenz ist somit der Schlüssel, um KI nicht als undurchschaubare Blackbox, sondern als gestaltbares Werkzeug zu begreifen.

KI-Kompetenz als neue Kulturtechnik

Die Differenzierung der KI-Nutzung ist kein akademisches Spiel, sondern eine Notwendigkeit – und zwar aus gleich mehreren Gründen. Technisch betrachtet ist KI längst nicht mehr „ausschaltbar“, da sie tief in unsere digitalen Arbeitsumgebungen integriert ist. Ethisch stellt jede Stufe der KI-Kollaboration andere Anforderungen an Verantwortung und Qualität: Wer haftet für Fehler, wie sicher sind die Quellen, und wo bleibt die menschliche Reflexion? Praktisch zeigt sich, dass bewusste Entscheidungen über den Einsatz von KI zu besseren Ergebnissen führen – sei es in der Bildung, im Berufsalltag oder in der gesellschaftlichen Debatte.

Daher lautet die zentrale Frage heute nicht mehr: „Nutzen wir KI?“ sondern vielmehr: „Wie nutzen wir sie – und welche Rolle wollen wir ihr in unserem Handeln, Denken und Gestalten einräumen?“

Diese Frage zu beantworten, ist der erste Schritt, um KI nicht als unkontrollierbare Macht, sondern als verantwortungsvoll einsetzbares Werkzeug zu begreifen. Es geht darum, die Technologie so zu nutzen, dass sie den Menschen unterstützt, ohne ihn zu ersetzen oder zu überfordern. KI-Kompetenz wird so zu einer neuen Kulturtechnik, die wir alle erlernen müssen.